分享币圈内容,享内容挖矿收益

placeholder

SoominStar

7天邀请嘉年华第3阶段:每日签到,最高可赚取1,100 USDT https://www.gate.com/campaigns/4196?ref=XlNDU1sM&ref_type=132&utm_cmp=hkCSUVNj

查看原文

- 赞赏

- 1

- 评论

- 转发

- 分享

$GASS

可能不会自己交易这个,因为最近新闻把这个图表带得太疯狂,但这是一个不错的看涨结构,伴随着看涨突破的成交量。不过如果这个持续上涨,对整体市场来说可能不是个好兆头。

查看原文可能不会自己交易这个,因为最近新闻把这个图表带得太疯狂,但这是一个不错的看涨结构,伴随着看涨突破的成交量。不过如果这个持续上涨,对整体市场来说可能不是个好兆头。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

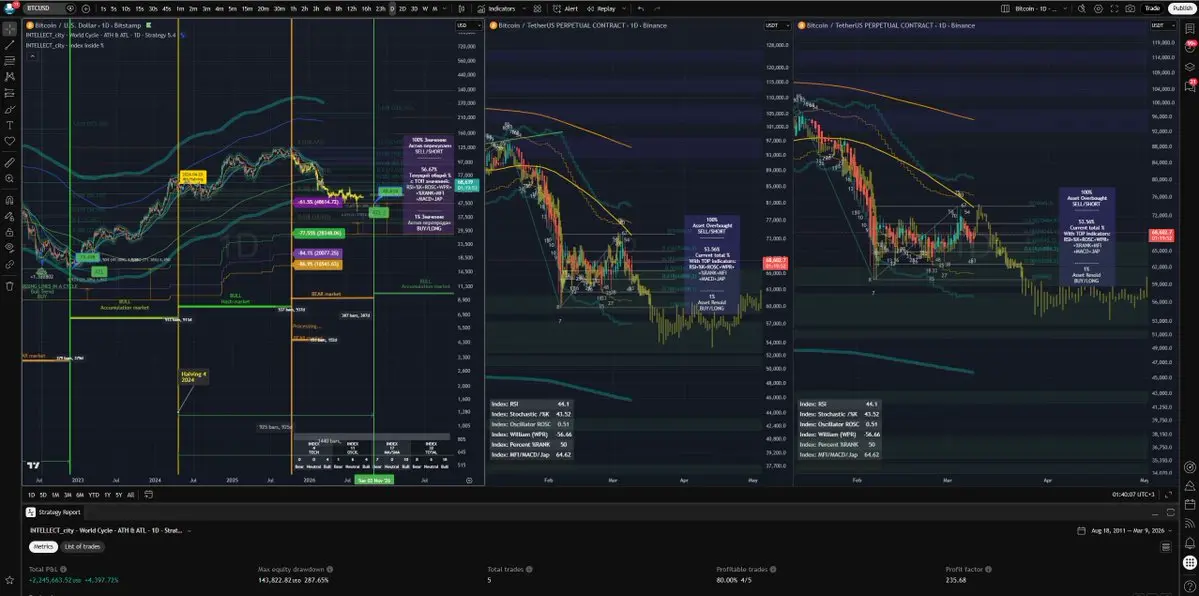

本周有CPI、PCE和GDP数据。

我最关注明天的CPI数据,预计会低于预期。不过目前这些数据都只是次要的,因为美国战争局势才是市场焦点,导致波动率飙升。原油现在走势跟山寨币一样,VIX也冲破30(这种情况很少见)。

特朗普每天都在换说法——但说到底,对市场也就是短期噪音。加密本来就处于熊市,SPX也早已见顶回落。

所以我更喜欢做宏观级别的HTF交易。忽略每天被各种新闻轰炸带来的干扰,真的很有帮助,尤其是对新手来说,这种噪音太消耗精力了。

一般来说,当主要央行(美、中、欧)开始放水时,资产市场就受益;一旦收紧,就承压。对我而言,最理想的情况是:放水先暂停一阵,等夏天过后再重启宽松。这样正好符合我的剧本——趁着夏季低位布局一些长线多头仓位,拿得住几个月甚至几年!

🙌

我最关注明天的CPI数据,预计会低于预期。不过目前这些数据都只是次要的,因为美国战争局势才是市场焦点,导致波动率飙升。原油现在走势跟山寨币一样,VIX也冲破30(这种情况很少见)。

特朗普每天都在换说法——但说到底,对市场也就是短期噪音。加密本来就处于熊市,SPX也早已见顶回落。

所以我更喜欢做宏观级别的HTF交易。忽略每天被各种新闻轰炸带来的干扰,真的很有帮助,尤其是对新手来说,这种噪音太消耗精力了。

一般来说,当主要央行(美、中、欧)开始放水时,资产市场就受益;一旦收紧,就承压。对我而言,最理想的情况是:放水先暂停一阵,等夏天过后再重启宽松。这样正好符合我的剧本——趁着夏季低位布局一些长线多头仓位,拿得住几个月甚至几年!

🙌

- 赞赏

- 点赞

- 评论

- 转发

- 分享

soil

somoil

创建人@Maanka

上市进度

0.00%

市值:

$2448.12

更多代币

#CircleStockRises9.7%Monday – 来自加密金融科技行业的强烈信号

金融市场在本周初出现了令人印象深刻的上涨,Circle Internet Financial的股价在周一交易时段大幅上涨,涨幅接近9.7%。这一突如其来的上涨引起了传统金融和加密货币生态系统投资者的关注,凸显了对那些在金融科技创新与数字资产交汇处运营的公司的重新乐观情绪。这次反弹表明,市场参与者再次将目光投向在加密经济中扮演基础性角色的基础设施公司,而不仅仅关注波动性较大的代币。

推动此次上涨的主要因素之一似乎是对Circle旗舰稳定币产品USD Coin的信心不断增强。随着数字支付领域的持续发展,稳定币被越来越多地视为连接传统金融与区块链系统的关键工具。Circle已将自己定位为该领域最具影响力的参与者之一,提供受监管、广泛采用的美元支持数字资产,支持交易、支付和去中心化金融应用。稳定币在交易所、金融科技平台和支付网络中的持续扩展,强化了这样一种观点:构建加密基础设施的公司可能会实现长期增长。

周一的反弹并非仅仅是由投机驱动的随机价格波动。交易数据显示,CRCL的市场活跃度明显高于其日均交易量。较高的交易量通常反映出机构投资者或高价值散户交易者的积极参与,他们根据市场预期主动建仓。当价格上涨伴随着交易量激增时,通常意味着这一走势得到了真实买盘的支撑,而非短暂的市场噪音。这一动态促使分析师们

查看原文金融市场在本周初出现了令人印象深刻的上涨,Circle Internet Financial的股价在周一交易时段大幅上涨,涨幅接近9.7%。这一突如其来的上涨引起了传统金融和加密货币生态系统投资者的关注,凸显了对那些在金融科技创新与数字资产交汇处运营的公司的重新乐观情绪。这次反弹表明,市场参与者再次将目光投向在加密经济中扮演基础性角色的基础设施公司,而不仅仅关注波动性较大的代币。

推动此次上涨的主要因素之一似乎是对Circle旗舰稳定币产品USD Coin的信心不断增强。随着数字支付领域的持续发展,稳定币被越来越多地视为连接传统金融与区块链系统的关键工具。Circle已将自己定位为该领域最具影响力的参与者之一,提供受监管、广泛采用的美元支持数字资产,支持交易、支付和去中心化金融应用。稳定币在交易所、金融科技平台和支付网络中的持续扩展,强化了这样一种观点:构建加密基础设施的公司可能会实现长期增长。

周一的反弹并非仅仅是由投机驱动的随机价格波动。交易数据显示,CRCL的市场活跃度明显高于其日均交易量。较高的交易量通常反映出机构投资者或高价值散户交易者的积极参与,他们根据市场预期主动建仓。当价格上涨伴随着交易量激增时,通常意味着这一走势得到了真实买盘的支撑,而非短暂的市场噪音。这一动态促使分析师们

- 赞赏

- 2

- 评论

- 转发

- 分享

GN CT 🌃

我对 @XOOBNetwork 展示的内容印象深刻。在Web3领域很长一段时间里,关注度一直用错误的数字来衡量,粉丝数、点赞数或观看次数并不总能创造真正的价值。XOOB的做法不同。创作者分享活动,用户参与,平台跟踪结果。创作者带来越多真实关注,就赚得越多。

没有粉丝数的炫耀,没有空洞的互动指标。只有你可以看到和衡量的真实贡献。

我们明天再来,家人💤

查看原文我对 @XOOBNetwork 展示的内容印象深刻。在Web3领域很长一段时间里,关注度一直用错误的数字来衡量,粉丝数、点赞数或观看次数并不总能创造真正的价值。XOOB的做法不同。创作者分享活动,用户参与,平台跟踪结果。创作者带来越多真实关注,就赚得越多。

没有粉丝数的炫耀,没有空洞的互动指标。只有你可以看到和衡量的真实贡献。

我们明天再来,家人💤

- 赞赏

- 2

- 评论

- 转发

- 分享

我在77做多油价,之后被套

现在全仓

清算价在69

我仍然相信油价会突破$100 并长时间保持在那里

这次假跌和市场操纵将是短期的

是的,你最喜欢的股票不会上涨

是的,最终你会后悔的

查看原文现在全仓

清算价在69

我仍然相信油价会突破$100 并长时间保持在那里

这次假跌和市场操纵将是短期的

是的,你最喜欢的股票不会上涨

是的,最终你会后悔的

- 赞赏

- 1

- 评论

- 转发

- 分享

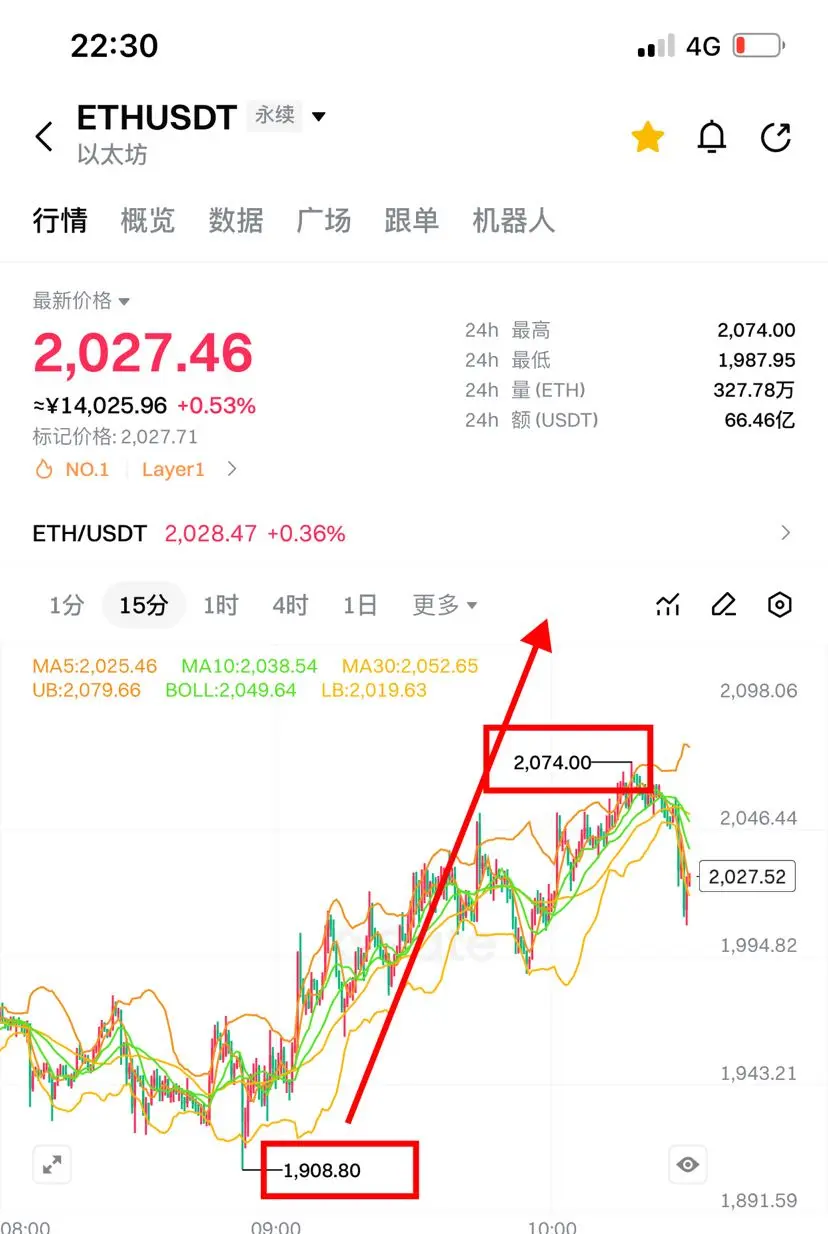

以太重磅解析

- 赞赏

- 点赞

- 评论

- 转发

- 分享

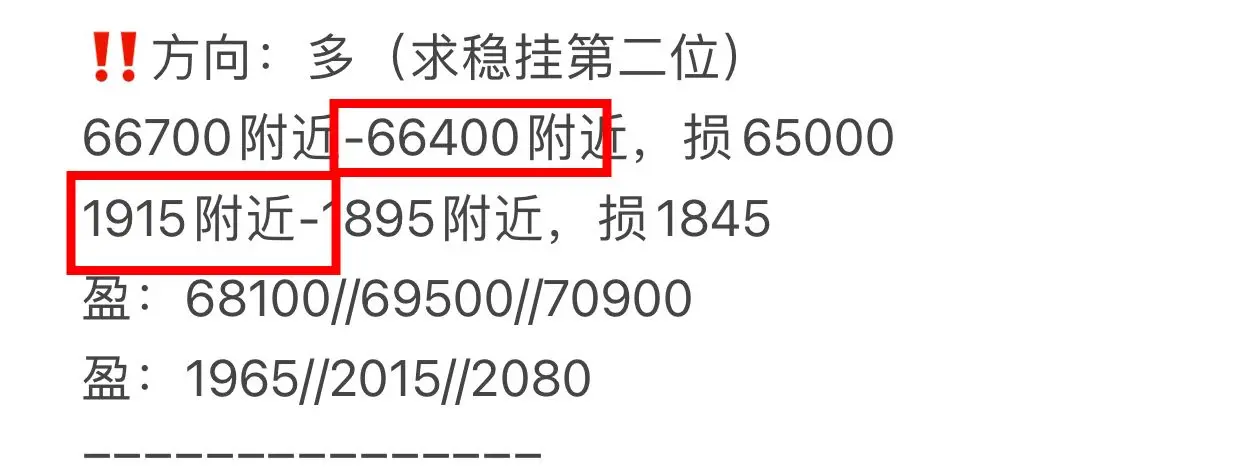

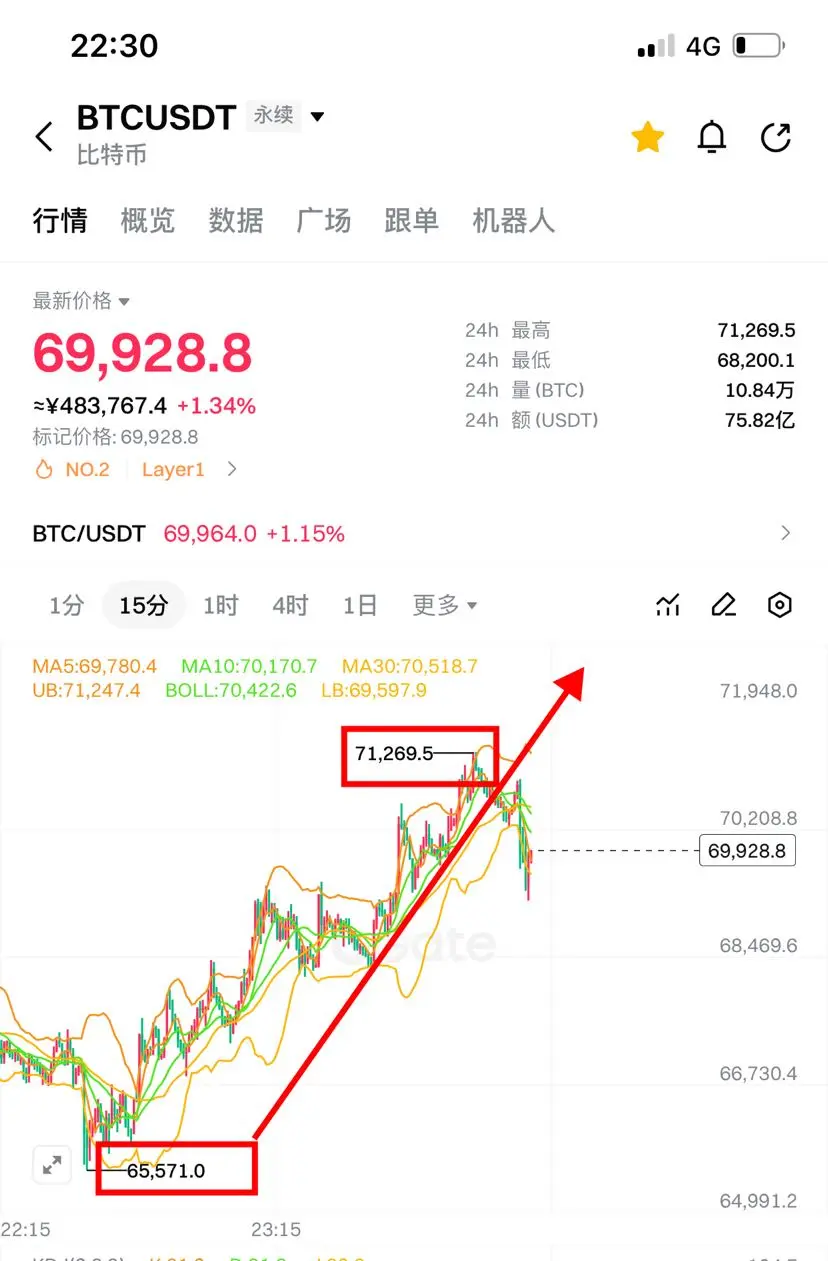

直播短线点位直接给

- 赞赏

- 点赞

- 评论

- 转发

- 分享

GOD

GOD CIA

创建人@大鲨鱼社区CZ

认购进度

0.00%

市值:

$0

更多代币

如果你对一家公司真正看涨到极点,以下是如何利用杠杆的方式:

1. 卖出你最有信心的股票的1年期担保看跌期权。

2. 将部分期权费用来立即买入股票。

3. 用剩余的期权费购买同一公司的LEAP看涨期权。

你现在以三重杠杆持有多头仓位,且无需额外出资。

保持比例合理,你绝不会在市场波动中被清仓。

大多数人会做现金担保看跌期权,却错过了他们所谓看涨的公司的全部涨幅。

那不算是一种策略……

查看原文1. 卖出你最有信心的股票的1年期担保看跌期权。

2. 将部分期权费用来立即买入股票。

3. 用剩余的期权费购买同一公司的LEAP看涨期权。

你现在以三重杠杆持有多头仓位,且无需额外出资。

保持比例合理,你绝不会在市场波动中被清仓。

大多数人会做现金担保看跌期权,却错过了他们所谓看涨的公司的全部涨幅。

那不算是一种策略……

- 赞赏

- 1

- 评论

- 转发

- 分享

#AnthropicSuesUSDefenseDepartment ⚖️ 当人工智能伦理与国家安全发生冲突

全球人工智能竞赛刚进入一个危险的新阶段。

世界领先的人工智能公司之一现在正在起诉美国政府——其结果可能重塑人工智能在战争、技术,甚至更广泛的科技投资格局中的应用方式。

冲突的核心是Anthropic,这家Claude AI模型的开发商。

而对手正是美国国防部。

这不是一场例行的法律争端。

而是关于谁最终掌控强大AI系统未来的对抗。

🧠 诉讼的触发原因是什么?

五角大楼最近将Anthropic列为“供应链风险”。

这一分类通常用于被认为对国家安全构成威胁的外国公司或实体。

而非美国的AI开发商。

这一标记实际上阻止国防承包商将Anthropic的AI整合到五角大楼相关系统中——这一举措可能会对该公司访问全球最大技术采购生态系统之一产生重大影响。

Anthropic回应提起诉讼,辩称政府的决定是非法且有害的。

据该公司称,这一标记是对其拒绝削弱某些AI安全限制的报复。

这些限制据报道包括:

• 大规模国内监控

• 完全自主的致命武器系统

• AI决策工具的失控军事部署

Anthropic坚持认为,这些安全措施对于负责任的AI发展至关重要。

⚖️ 关于AI控制的法律之战

在法律挑战中,Anthropic声称政府的行动:

• 违反了正当程序保护

• 损害了政府合同中的公平竞争

•

查看原文全球人工智能竞赛刚进入一个危险的新阶段。

世界领先的人工智能公司之一现在正在起诉美国政府——其结果可能重塑人工智能在战争、技术,甚至更广泛的科技投资格局中的应用方式。

冲突的核心是Anthropic,这家Claude AI模型的开发商。

而对手正是美国国防部。

这不是一场例行的法律争端。

而是关于谁最终掌控强大AI系统未来的对抗。

🧠 诉讼的触发原因是什么?

五角大楼最近将Anthropic列为“供应链风险”。

这一分类通常用于被认为对国家安全构成威胁的外国公司或实体。

而非美国的AI开发商。

这一标记实际上阻止国防承包商将Anthropic的AI整合到五角大楼相关系统中——这一举措可能会对该公司访问全球最大技术采购生态系统之一产生重大影响。

Anthropic回应提起诉讼,辩称政府的决定是非法且有害的。

据该公司称,这一标记是对其拒绝削弱某些AI安全限制的报复。

这些限制据报道包括:

• 大规模国内监控

• 完全自主的致命武器系统

• AI决策工具的失控军事部署

Anthropic坚持认为,这些安全措施对于负责任的AI发展至关重要。

⚖️ 关于AI控制的法律之战

在法律挑战中,Anthropic声称政府的行动:

• 违反了正当程序保护

• 损害了政府合同中的公平竞争

•

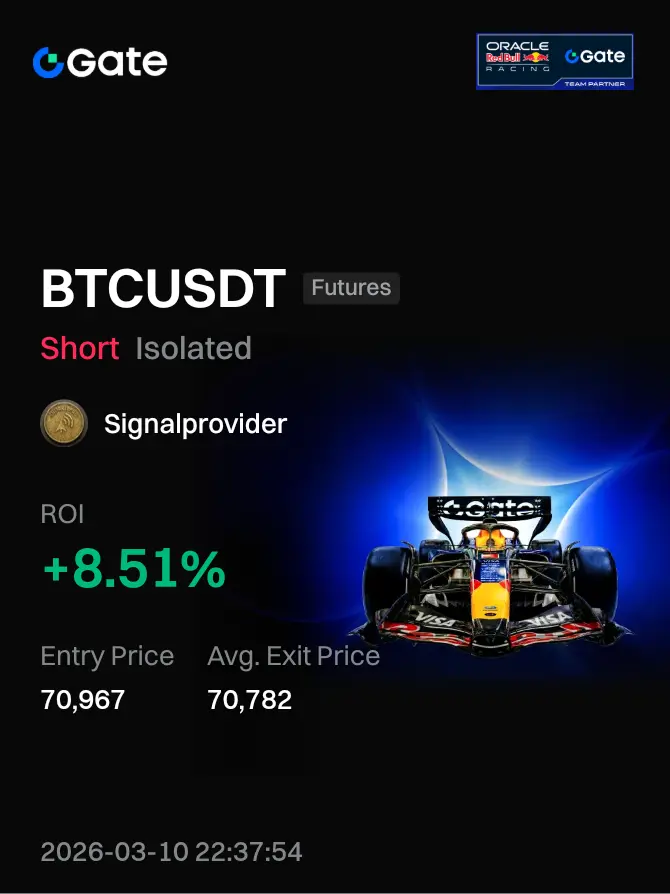

【当前用户分享了他的交易卡片,若想了解更多优质交易信息,请到 App 端查看】

- 赞赏

- 2

- 评论

- 转发

- 分享

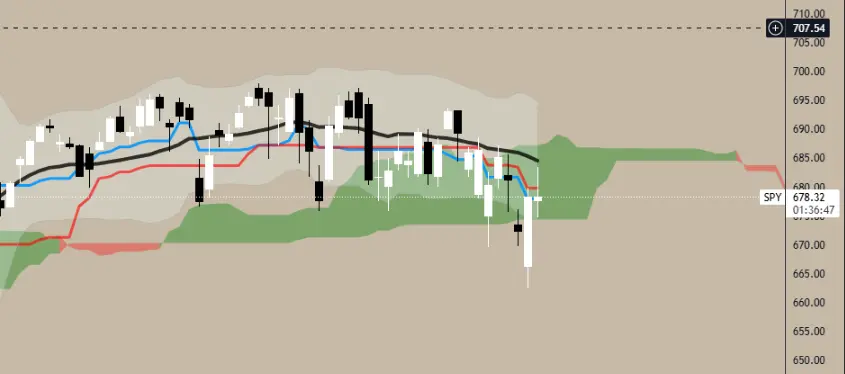

$SPY 我希望有更深的回调,但反弹接近1日均值回归点,所以如果我们能扭转那一点,就可以继续上涨。

个人想在660以下买入看涨期权,所以让我们看看这个月会发生什么,以及我是否需要在更高的价格买入。

查看原文个人想在660以下买入看涨期权,所以让我们看看这个月会发生什么,以及我是否需要在更高的价格买入。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

如果你不知道那个陷阱,那真是太愚蠢了。Mariano迄今为止最强烈的警告——2022年的情况正在现场直播。这不是演习。别被陷进去。

#Bitcoin #BTC #TradingTrap #CryptoWarning #DYOR

#Bitcoin #BTC #TradingTrap #CryptoWarning #DYOR

BTC2.34%

- 赞赏

- 2

- 评论

- 转发

- 分享

祝Gate交易所的所有女性工作人员妇女节快乐!❤️

致敬币圈女性力量:温柔有锋芒,普通人也能稳稳发财

币圈从来不是男性主场,无数普通女性用理性与坚持,在这里踏实赚钱、活出底气。上海40岁的李姐,就是身边最真实的例子。

10年前,李姐拿着15万积蓄试水币圈,不追热点、不碰高杠杆,只深耕主流币。她每天花1小时研究行情,坚持分批建仓、及时止盈,用女性的细致严控风险。牛熊交替中,她不慌不忙,把波动变成机会,从15万滚到3000万,还置办了4套房产,把投资收益变成稳稳的生活底气。

她的赚钱秘诀很亲民:不贪快钱、不盲从消息,守好本金、长期布局。和李姐一样,币圈还有很多女性:宝妈利用碎片时间做社区运营赚稳定收益;职场女生靠定投实现资产增值;创业者深耕区块链内容,用专业变现。

她们用行动证明,性别不是门槛,细心、耐心、责任心才是财富密码。致敬每一位在币圈努力的女性,不被定义、不惧挑战,用自己的方式积累财富、实现成长。愿更多女生理性进场,在数字世界里,温柔有力量,赚钱有方向#致敬币圈女性力量

致敬币圈女性力量:温柔有锋芒,普通人也能稳稳发财

币圈从来不是男性主场,无数普通女性用理性与坚持,在这里踏实赚钱、活出底气。上海40岁的李姐,就是身边最真实的例子。

10年前,李姐拿着15万积蓄试水币圈,不追热点、不碰高杠杆,只深耕主流币。她每天花1小时研究行情,坚持分批建仓、及时止盈,用女性的细致严控风险。牛熊交替中,她不慌不忙,把波动变成机会,从15万滚到3000万,还置办了4套房产,把投资收益变成稳稳的生活底气。

她的赚钱秘诀很亲民:不贪快钱、不盲从消息,守好本金、长期布局。和李姐一样,币圈还有很多女性:宝妈利用碎片时间做社区运营赚稳定收益;职场女生靠定投实现资产增值;创业者深耕区块链内容,用专业变现。

她们用行动证明,性别不是门槛,细心、耐心、责任心才是财富密码。致敬每一位在币圈努力的女性,不被定义、不惧挑战,用自己的方式积累财富、实现成长。愿更多女生理性进场,在数字世界里,温柔有力量,赚钱有方向#致敬币圈女性力量

- 赞赏

- 3

- 3

- 转发

- 分享

木生林森 :

:

坚定HODL💎查看更多

宇宙的创造者知道你的名字!

我希望你知道我所认识的耶稣

查看原文我希望你知道我所认识的耶稣

- 赞赏

- 点赞

- 评论

- 转发

- 分享

加载更多