Anthropic 起訴川普政府:「供應鏈風險」標籤屬非法報復

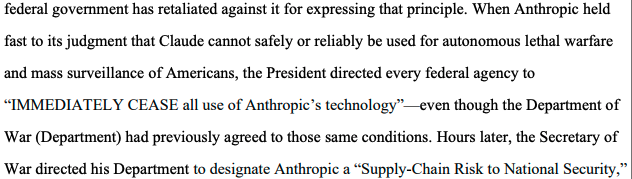

人工智慧軟體 Claude 的開發商 Anthropic 週一在加州聯邦法院對川普政府提起訴訟,指控政府對該公司發動了一場「非法報復行動」,理由是 Anthropic 拒絕允許軍方不受限制地使用其技術——包括用於致命性自主武器和大規模國內監控。這是美國歷史上首次有一家本土公司被認定為軍方供應鏈風險。

供應鏈風險標籤:五角大廈的史無前例認定

此次法律戰的起點,是國防部長 Pete Hegseth 在 2026 年 3 月 3 日最終確定的一項決定:將 Anthropic 列為軍方供應鏈風險企業。這項認定的法律後果直接且嚴重——任何與軍方有業務往來的個人或企業,將不得同時與 Anthropic 進行任何交易,等同於從聯邦採購市場中徹底將其驅逐。

值得注意的是,這種供應鏈風險認定在過去僅被用於那些被認定與外國敵對勢力存在關聯的公司,從未適用於美國本土企業。Anthropic 在訴訟中將此稱為「史無前例且非法」的行為,並主張:「憲法不允許政府動用其巨大的權力來懲罰一家公司受保護的言論。」

此次法律挑戰的被告陣容龐大,包括 Pete Hegseth(國防部長)、Scott Bessent(財政部長)、Marco Rubio(國務卿)及另外 17 個政府機構和官員,涵蓋美國聯邦政府的多個核心部門。

Anthropic 的核心紅線:致命武器與大規模監控

(來源:CourtListener)

(來源:CourtListener)

根據 Anthropic 在訴訟中的陳述,Hegseth 要求該公司「徹底放棄其使用限制」——而 Anthropic 拒絕的原因,是這些限制條款本身就是其政府合約的組成部分,旨在防止 Claude 被用於兩類特定用途:

致命性自主武器系統:即不需要人類最終決策確認的自動化殺傷決策系統

對美國公民的大規模監控:利用 AI 技術進行大規模蒐集和分析公民個人數據

Anthropic 在訴訟中明確表示:「Anthropic 從未針對這些用途測試過 Claude。目前 Anthropic 並不確信,如果將 Claude 用於支持致命的自主戰爭,它能否可靠或安全地運行。」

這一立場與 Anthropic 長期以來的 AI 安全優先原則一致,但與川普政府擴大軍事 AI 應用的政策方向發生了根本性衝突。值得注意的是,美國政府和五角大廈自 2024 年起一直在使用 Anthropic 技術,Claude 更是首個被部署在機密工作環境中的 AI。此次標籤認定也伴隨著川普直接下令聯邦雇員停止使用 Claude 的行政指令。

OpenAI 與 Google 工程師聯署聲援:AI 行業的集體響應

法律戰爆發後,AI 行業的反應迅速且廣泛。週一,來自 OpenAI 和 Google 的 30 多名工程師與科學家,包括 Google 首席科學家 Jeff Dean,提交了一份法律支持文件(amicus brief),公開聲援 Anthropic。

這些業界人士在文件中警告:「如果允許這種懲罰美國領先 AI 公司之一的行動繼續下去,無疑會對美國在人工智慧及其他領域的工業和科學競爭力產生負面影響。」這一說法指向一個更宏觀的擔憂——若美國政府以供應鏈風險為由打壓本土 AI 公司,可能削弱美國在全球 AI 競賽中對抗中國的核心優勢。

常見問題

「供應鏈風險」標籤對 Anthropic 的具體影響是什麼?

根據美國法律,被列為供應鏈風險企業意味著任何與軍方有業務往來的個人或實體,都不得同時與被列名公司進行交易。這相當於把 Anthropic 從整個聯邦政府採購生態中切除,影響其不僅限於直接軍事合約,還包括所有有政府業務的供應商和合作夥伴。

Anthropic 為何拒絕開放致命武器相關用途?

Anthropic 的立場是 Claude 從未針對致命性自主武器場景進行過測試和安全評估,公司目前無法確保在此類應用場景下的可靠性和安全性。此外,Anthropic 一貫的 AI 安全原則反對在沒有充分測試的情況下部署高風險的自主決策系統,尤其在涉及人命的軍事場景中。

Google 和 OpenAI 工程師聲援 Anthropic 意味著什麼?

30 名來自競爭對手公司的工程師和科學家跨越商業競爭聯署聲援,反映出 AI 行業對政府以供應鏈標籤干預 AI 公司的深切憂慮。他們的聲援指向一個共同利益:若政府可以用此類工具打壓不配合的 AI 公司,任何拒絕開放技術限制的公司都可能面臨相同命運。