Anthropic告上法院!指控川普政府報復封殺Claude,37位AI研究者聲援

Anthropic 提告聯邦政府,反對被列供應鏈風險並限 6 個月停用 Claude,AI 軍事用途與安全治理爭議升溫。

遭列為「供應鏈風險」,Anthropic提告聯邦政府

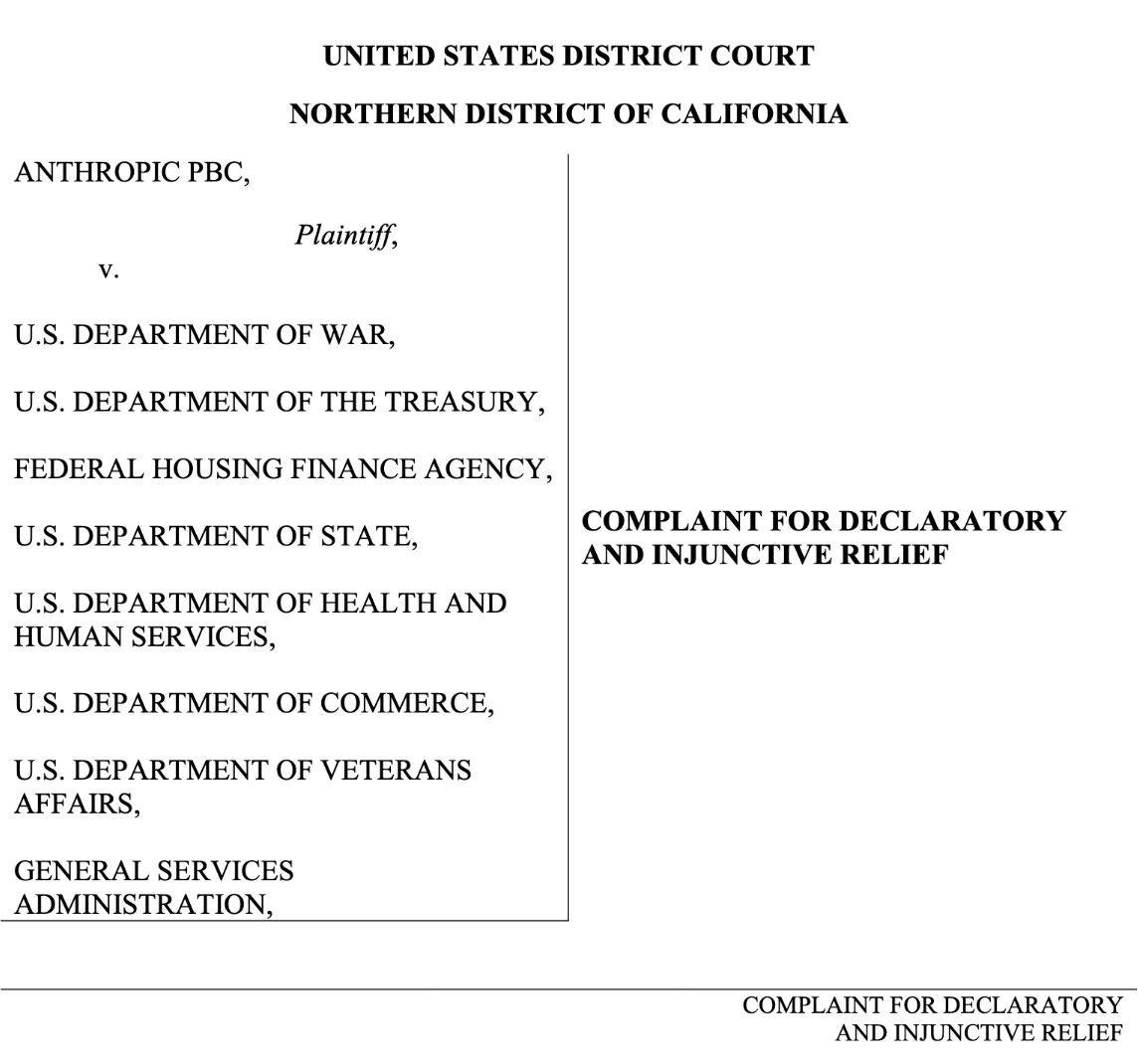

人工智慧公司 Anthropic 近日向美國聯邦法院提起訴訟,指控川普政府將其列為「供應鏈風險」(supply chain risk)企業,並要求各聯邦機構停止使用其 AI 系統。公司認為這項措施屬於報復性打壓。該訴訟已提交至美國加州北區聯邦地方法院。

Anthropic 在訴狀中指出,政府行動缺乏法律依據,並對公司營運與合作關係造成重大衝擊。訴訟文件將多個政府機構與官員列為被告,包括美國國防部、國防部長皮特・赫格塞斯(Pete Hegseth)、財政部長史考特・貝森特(Scott Bessent)、國務卿馬可・盧比歐(Marco Rubio),以及商務部長霍華德・盧特尼克(Howard Lutnick)。

圖源:Anthropic Anthropic 向美國聯邦法院提起訴訟,指控川普政府將其列為「供應鏈風險」企業,並要求各聯邦機構停止使用其 AI 系統

「供應鏈風險」的標籤通常用於涉及敵對國家的科技企業,例如可能包含間諜程式或惡意軟體的供應商。Anthropic 指出,將一家美國 AI 公司納入該分類,對公司聲譽與商業合作造成明顯衝擊。Anthropic 表示,公司透過司法程序尋求釐清政府行動是否合法,同時維護企業、客戶與合作夥伴的利益。

AI軍事用途爭議,國防 AI 合約談判破裂

此次衝突的核心,源於 Anthropic 與美國國防部對 AI 技術使用方式的分歧。Anthropic 先前曾與五角大廈洽談一項最高價值約 2 億美元的 AI 合約。談判過程中,國防部要求 AI 系統必須能夠在所有合法用途下使用,包括軍事場景。Anthropic 堅持保留兩項安全限制:

- 禁止其 AI 模型 Claude 用於大規模監控美國民眾;

- 禁止用於完全自主的致命武器系統。

公司認為這些限制屬於 AI 安全治理的重要原則。雙方立場始終無法取得共識。2026 年 2 月,美國政府將 Anthropic 列為供應鏈風險企業,並要求聯邦機構在 6 個月內停止使用 Claude 系統。

Anthropic 在訴狀中指出,政府利用行政權力向企業施壓,試圖迫使公司調整 AI 安全政策。公司律師表示,美國憲法並不允許政府因企業公開立場而採取懲罰性措施。

延伸閱讀

國安V.S倫理:Anthropic拒絕移除Claude安全護欄,槓上美國國防部

科技界聲援,37 名 AI 研究者提交法庭意見

Anthropic 與政府的衝突迅速在科技產業引發討論。訴訟提出後不久,來自 OpenAI 與 Google 等公司的 37 名人工智慧研究人員向法院提交意見書,表達對 Anthropic 的支持。這些研究人員認為,如果政府因 AI 安全政策分歧而對企業採取懲罰措施,可能削弱美國在人工智慧產業的競爭力。

意見書指出,若政府以國家安全為理由打壓 AI 企業,將對科技產業與研究環境產生長期影響。部分學者也指出,「供應鏈風險」通常用於涉及外國軟體安全疑慮的情境。Anthropic 的案例與此類風險並不相同。

人工智慧企業 SingularityNET 執行長 Ben Goertzel 表示,拒絕讓 AI 用於大規模監控或自主殺傷武器並不構成安全威脅。若軍方需要這類用途,可以選擇其它 AI 系統。

圖源:DigFin 人工智慧企業 SingularityNET 執行長 Ben Goertzel

政府與科技業衝突升溫,AI 政策爭議擴大

面對訴訟,白宮迅速回應,表示政府不會允許企業限制美國軍方使用關鍵技術。白宮發言人指出,美國政府必須確保軍方能在合法範圍內運用必要技術維護國家安全。

這場爭議也牽動更廣泛的科技政策議題。川普政府先前放寬 AI 晶片對中國出口限制,同時對部分科技企業的政治立場提出批評,使矽谷與華府之間的關係更加緊張。

Anthropic 表示,被列入黑名單後,部分與國防部合作的企業可能必須證明其系統沒有使用 Claude。這項要求可能對公司商業合作產生連鎖影響。

部分大型科技企業仍表態支持 Anthropic。Google 表示將繼續向雲端客戶提供 Anthropic 的 AI 技術,但不涉及國防用途。Microsoft 與 Amazon 也表示,將持續在商業產業與該公司合作。

Anthropic 已向法院提出請求,要求宣告政府行動違法,並阻止「供應鏈風險」標籤的執行。案件進入司法程序後,圍繞 AI 安全治理、國家安全與企業自主權的討論也持續擴大。

延伸閱讀

OpenAI合作美軍爆抵制潮!Claude App下載超車,看懂背後倫理與政治角力

華爾街日報:川普祭出Anthropic封殺令後,美以空襲伊朗仍依賴Claude