Мілашка Джова Вікі за допомогою ШІ створила «проєкт на відмінно»? Перевірка розробників: це справді змістовно чи перебільшене хайп-розкручування?

Система AI-пам’яті MemPalace, у розробці якої брала участь Мілла Йовович, заявляє, що тести були виконані на 100% і через це стала вірусною, проте спільнота викрила її: тестування нібито супроводжувалося шахрайством і маніпуляціями даними. Під час практичної перевірки з’ясувалося, що ефект переоцінено і виявлено багато помилок; команда визнала недоліки та вже працює над їхнім виправленням.

Мілла Йовович створила AI-палац пам’яті, що привернув увагу ззовні

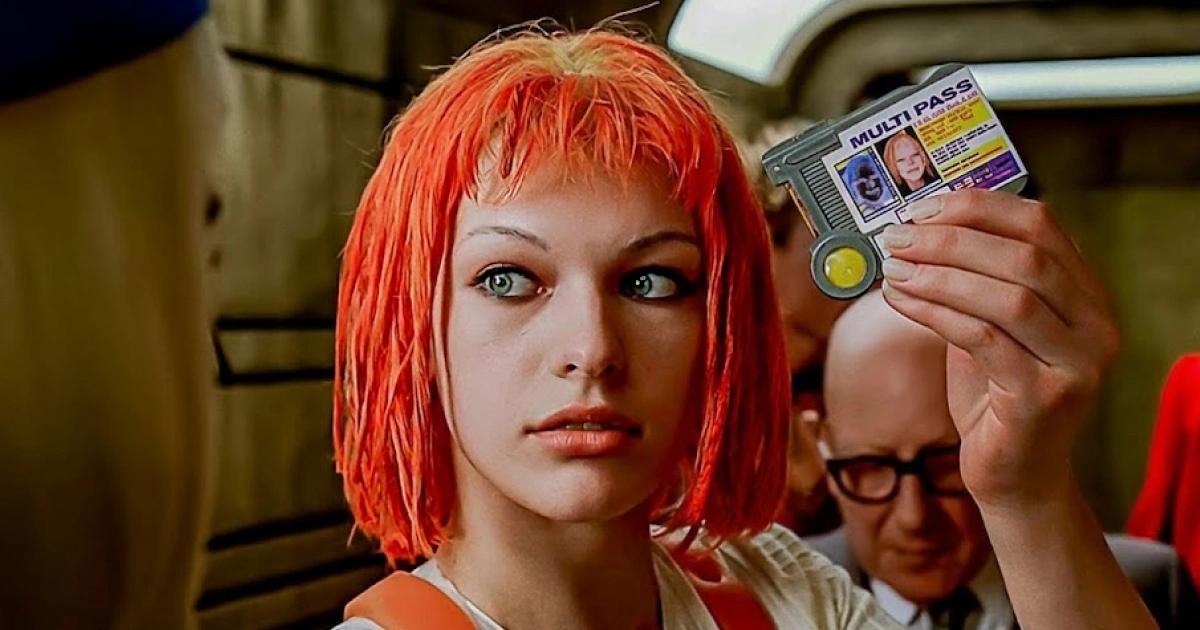

Учора (4/7) у колі AI з’явилася велика новина: голлівудська акторка Мілла Йовович (Milla Jovovich), відома ролями у «Останній охороні», «П’ятому елементі», разом із розробником Ben Sigman використала Claude Code для допомоги в розробці відкритої «MemPalace» як системи AI-пам’яті.

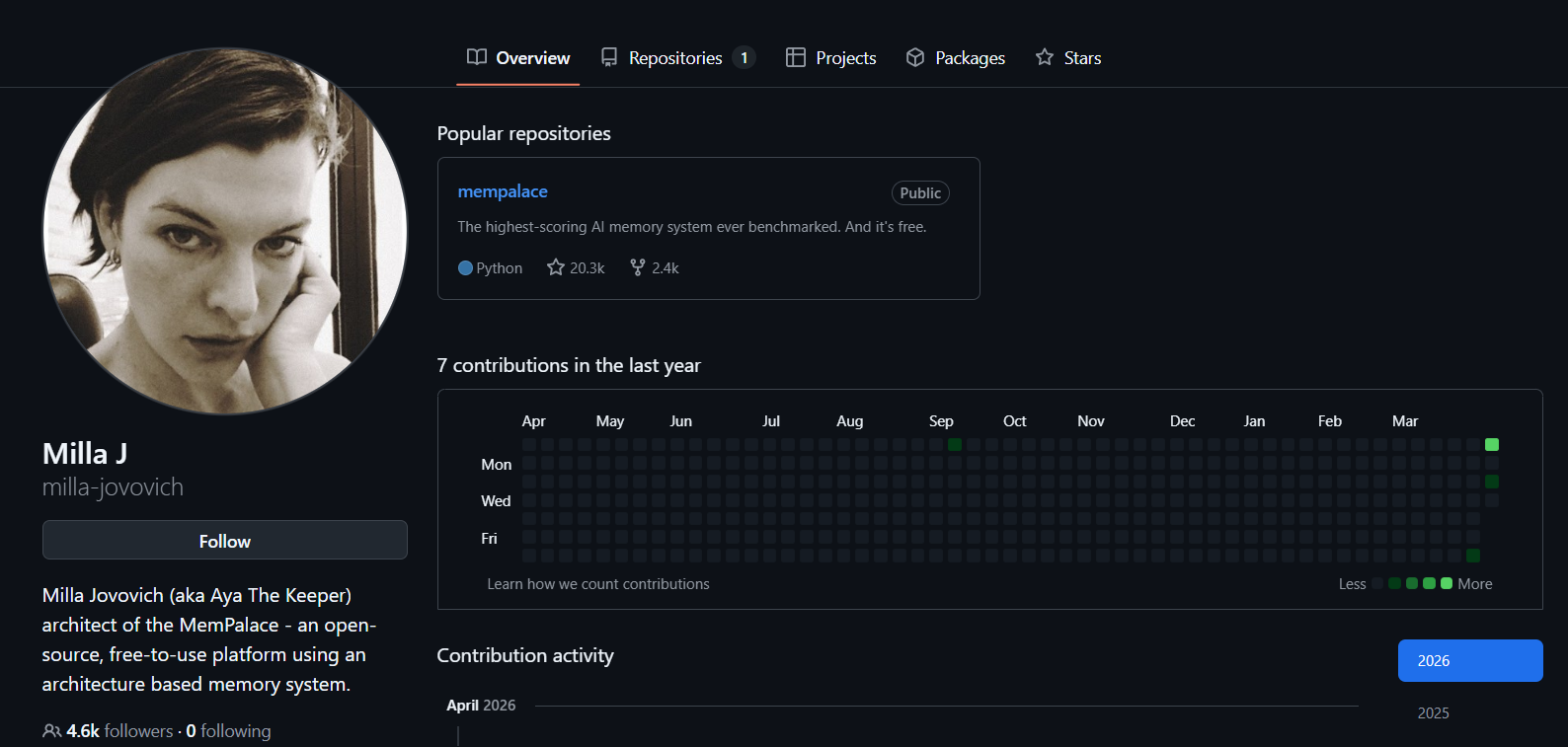

Одразу поширилася думка «голлівудська зірка вийшла на інший рівень і створила проєкт на максимум балів», і донині MemPalace на GitHub має понад 20 000 зірок, але дуже швидко розробницька спільнота почала сумніватися: це справді щось вартісне чи просто піар?

Спочатку розберімо мотив появи MemPalace. У офіційній документації сказано, що команда хоче вирішити проблему, коли в поточних AI-системах вміст діалогів користувачів з AI, процес ухвалення рішень та обговорення архітектури зазвичай зникають після завершення робочого етапу, через що місячні зусилля фактично падають до нуля.

Для вирішення цієї проблеми MemPalace використовує просторову архітектуру для зберігання пам’яті: інформацію чітко групують у «крилові зони» для представників або проєктів, а також у різні рівні структури, як-от коридори, кімнати та шухляди, зберігаючи оригінальний текст діалогу для подальшого семантичного пошуку.

Команда розробників заявляє, що MemPalace досягла ідеальних 100% у довготривалому оціночному базисі пам’яті LongMemEval, і водночас отримала 96.6% точності без виклику будь-яких зовнішніх API, а також може повністю працювати локально, не потребуючи підписки на хмарні сервіси, і доповнена заявленою системою діалектів AAAK, що нібито здатна забезпечити 30-кратне безвтратне стиснення.

Джерело зображення: GitHub Голлівудська зірка Мілла Йовович створила AI-палац пам’яті, що привернув увагу ззовні

Колеги та спільнота одночасно піддали сумніву, тестування та просування мають недоліки

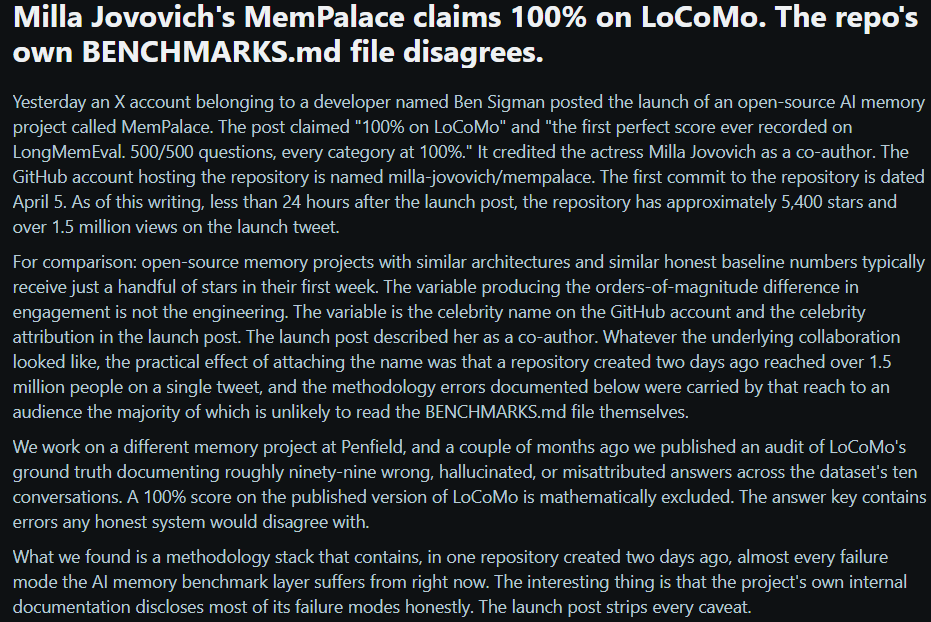

Однак, заявлена MemPalace ідеальна оцінка LongMemEval дуже швидко викликала сумніви з боку колег.

PenfieldLabs, компанія, що також створює системи AI-пам’яті, зазначила, що MemPalace стверджує: у датасеті LoCoMo вона отримала 100%, що математично не могло статися, адже стандарти відповідей у цьому датасеті самі містять 99 помилок.

У своєму аналізі PenfieldLabs виявила, що 100% результат MemPalace походить із встановлення кількості запитів на пошук на 50 разів, але для тестових діалогів максимальна кількість етапів становить лише 32, що означає: система напряму обходить етап пошуку й передає всі дані AI-моделі для читання.

Щодо 100% результату в LongMemEval команду розробників викрили: виявилося, що вона націлилася на 3 конкретні проблеми, які зосереджені на розробці та дали збій, написала спеціальний код для виправлення, і це створює підозру, що під час тестування було здійснено шахрайство з тестовим набором.

Джерело зображення: Reddit Колега PenfieldLabs вказує, що MemPalace стверджує: у датасеті LoCoMo отримала ідеальний результат, але математично цього не могло статися

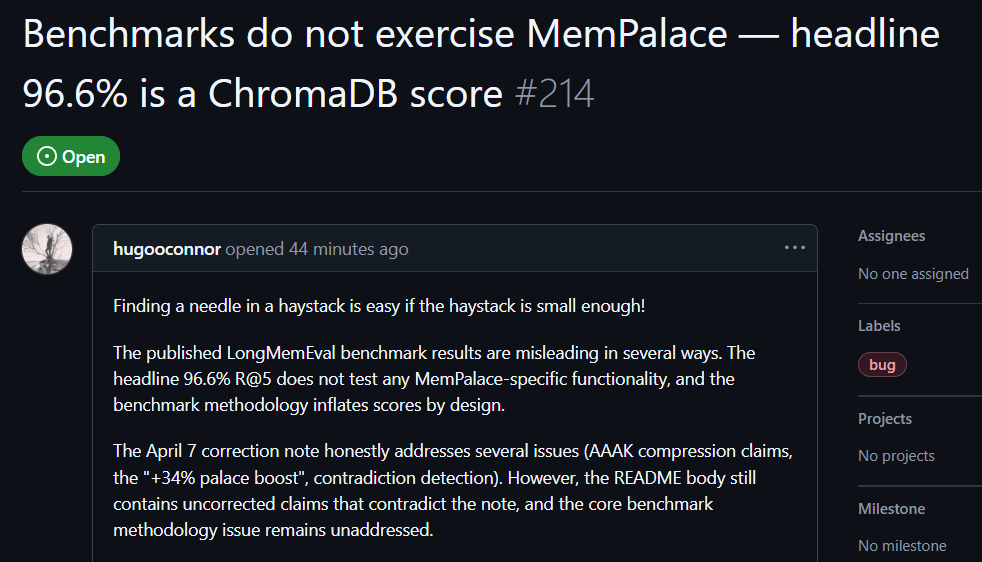

Практична перевірка на GitHub: базові тести мають елементи введення в оману

Користувач GitHub hugooconnor після практичної перевірки прокоментував: MemPalace заявляє аж 96.6% точності пошуку, але насправді повністю не використовує архітектуру «AI-палацу пам’яті», яку вона рекламувала. hugooconnor каже, що їхнє тестування лише викликає стандартні можливості базового сховища ChromaDB і зовсім не стосується логіки категоризації, яку підкреслює проєкт, як-от крилові зони, кімнати або шухляди.

Після тестування hugooconnor з’ясував: коли система реально вмикає ці власні логіки категоризації палацу пам’яті, результат пошуку навпаки погіршується. Наприклад, у режимі «кімната» точність знижується до 89.4%, а після ввімкнення технології стиснення AAAK точність ще падає до 84.2%; у обох випадках це нижче, ніж показує стандартна робота бази даних.

hugooconnor також розкритикував методологію тестування: середовище тестування MemPalace навмисно звужує діапазон пошуку для кожного питання приблизно до 50 діалогових етапів, тож у дуже маленькій колекції зразків знайти відповідь надто легко.

Якщо розширити діапазон до понад 19,000 діалогових етапів у реальних сценаріях, точність традиційного пошуку за ключовими словами падає до 30%, що вказує: нинішній формат тестування MemPalace маскує реальну складність пошуку.

Джерело зображення: GitHub Практична перевірка користувача GitHub: у базовому тестуванні MemPalace є елементи введення в оману

Водночас, хоча команда розробників уже опублікувала заяву про виправлення і визнала, що технологія AAAK справді підтверджується як така, що є зі втратами, та пообіцяла на основі суворої критики спільноти відкоригувати документи й дизайн системи, головний опис проєкту досі зберігає кілька непідкоригованих перебільшень, зокрема заяви про 30-кратне безвтратне стиснення та 34% підвищення точності пошуку, а також порівняльні графіки з іншими конкурентами взагалі не містять джерел.

Вихідний код MemPalace стикається з багатьма Bug

Зі збільшенням кількості завантажень тестувань на GitHub з’явилася велика кількість звітів про Bug у вихідному коді MemPalace.

Користувач cktang88 навів низку серйозних недоліків: зокрема, команди для стиснення не працюють і спричиняють падіння системи, у логіці підрахунку кількості слів для підсумків є помилки, статистичні дані щодо «викопування кімнат» є неточними, а також сервер під час кожного виклику завантажує в пам’ять усі інтерпретаційні дані, що створює критичні проблеми зі споживанням ресурсів.

Серед інших вказаних проблем також є те, що система примусово записує назви домашніх членів розробника в типовий конфігураційний файл, а під час перевірки статусу існує обмеження на примусове відображення 10,000 записів даних.

Для цих проблем відкрита спільнота вже почала активно виправляти. Користувач adv3nt3 надіслав кільказапитів навиправлення, включно з виправленням статистичних даних «викопування», видаленням типових назв членів родини та відтермінуванням ініціалізації часу для знаннєвої граф-схеми. Після цього команда розробників також визнала ці помилки та поступово виправляє проблеми з кодом у співпраці з спільнотою.

Мілла Йовович Vibe Coding — це круто, а спосіб просування — ні

Щодо цього проєкту MemPalace користувач Hacker News darkhanakh зробив висновок: MemPalace залишає відчуття на кшталт OpenClaw, тобто штучно маніпулюють результатами базових тестів (benchmark), щоб вони виглядали ідеально бездоганними, а потім упаковують це як якусь велику проривну подію для маркетингу.

Він вважає, що базова технологія MemPalace може бути справді цікавою, але за умов, коли методика тестування має такі недоліки, а ще й продається як «найвищий публічно доступний результат в історії», це виглядає явно недоречно, «але, знаєте, з тією справою, що Мілла Йовович грає в Vibe Coding, я, мабуть, усе ж думаю, що це доволі круто».

Додаткове читання:

AI написала код і наробила проблем! Проблема з безпекою в додатку «Прагни не марнувати їжу» (дата продукції в супермаркеті на смітник), GPS вдома повністю «випав» в ефір

Пов'язані статті

Міф Клода: Firefox виявив 271 вразливість, захисники мають шанси отримати вирішальну перевагу

Попередження щодо IPO SpaceX: комерційна здійсненність бізнесу центрів обробки даних для космічного ШІ Ілона Маска під сумнівом

Claude Code скасовує виведення Pro-пакету, щоб його використовувати, потрібно оформити підписку Max! Керівники Anthropic заявляють, що це ще тестується

З’явилися ChatGPT Images 2.0! Точність генерації тексту значно зросла — легко створюйте маркетингові постери

OpenAI зобов’язується інвестувати до $1.5B у нове спільне підприємство з приватним капіталом

GPT-5.5 з’являється в селекторі OpenAI Codex, але повертає помилку 400; наразі недоступно